Informatica: fondamenti, architettura di Von Neumann e componenti del processore

Documento di Università su Informatica. Il Pdf esplora i fondamenti dell'informatica, dalla sua storia ai principi di funzionamento dei computer moderni. Il Pdf, utile per lo studio universitario, descrive l'architettura di Von Neumann, i componenti del processore e il ciclo di esecuzione delle istruzioni, definendo concetti chiave come algoritmi, hardware e software.

Mostra di più68 pagine

Visualizza gratis il Pdf completo

Registrati per accedere all’intero documento e trasformarlo con l’AI.

Anteprima

Storia del Calcolo Automatico

"Computer" -> viene dal latino computare, che significa calcolare o sommare insieme, ma i computer di oggi sono molto di più di giganti calcolatrici Per secoli l'uomo ha cercato di automatizzare il processo di calcolo con vari strumenti:

- ABACO (V millennio a.C.): la logica e la correttezza del calcolo dipendono dall'utente

- PASCALINA (XVII secolo d.C.): la logica dell'operazione è controllata dalla macchina ma permette di fare solo addizioni e sottrazioni, ma era di nuovo l'utente a controllare il processo

- MACCHINA ANALITICA (Charles Babbage, 1840): primo esempio di macchina di calcolo programmabile. Le sue idee vengono riprese nella prima metà del '900 da Von Neumann.

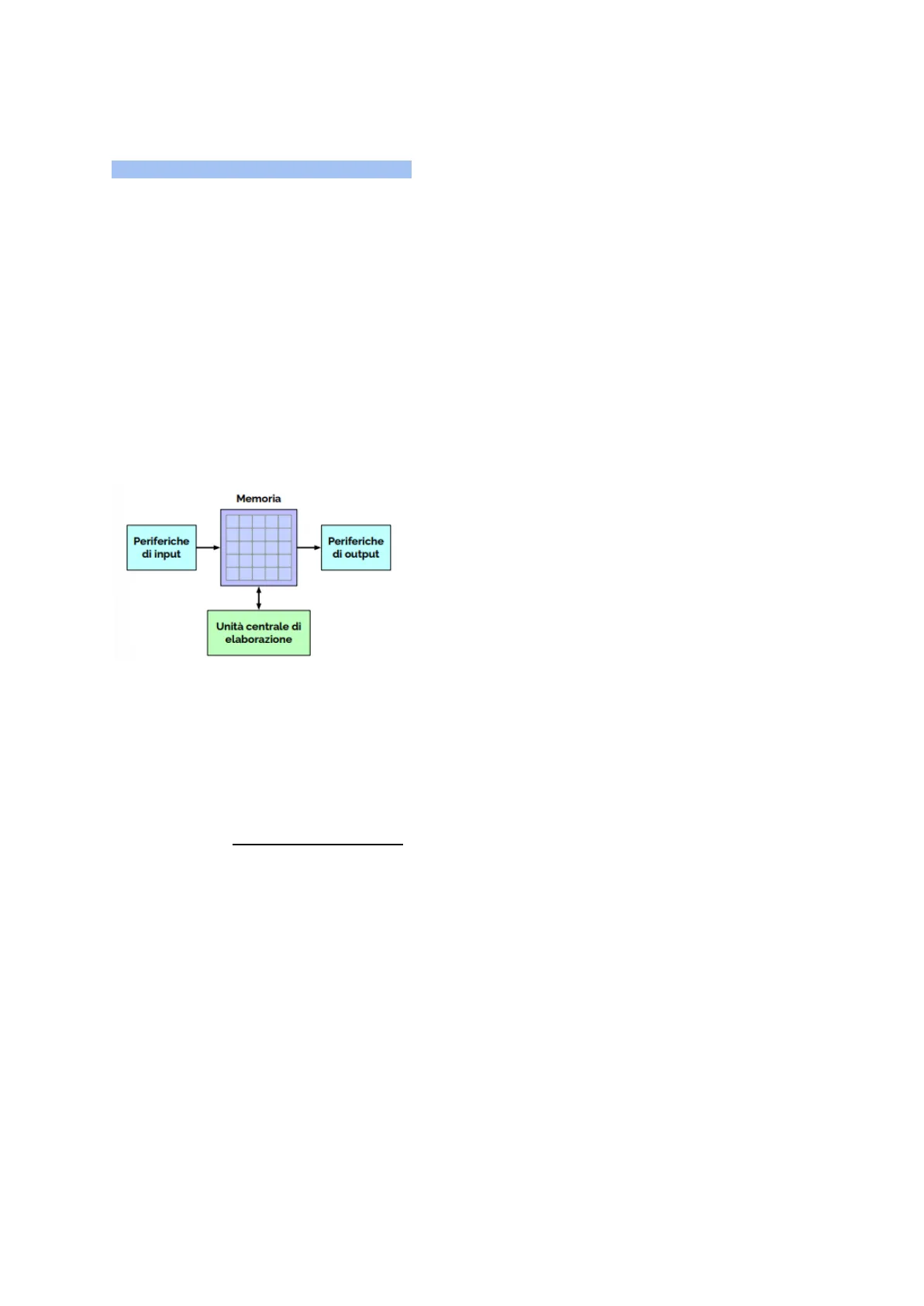

Architettura di Von Neumann

Memoria Periferiche di input Periferiche di output E' ancora oggi il modello su cui si basano i computer:

- memoria: programmi e dati da elaborare

- input: permette l'inserimento di dati

- output: permette di mostrare il risultato dell'elaborazione

- unità centrale: elabora le info della memoria Unità centrale di elaborazione La cosa importante è che sia dati che programmi vengono trattati in modo omogeneo ed immagazzinati nella stessa unità di memoria

Eniac (1943) è stata la prima macchina ad utilizzare questa architettura. Costruito durante la 2 guerra mondiale doveva essere in grado di risolvere problemi di calcolo balistico per il lancio dei proiettili d'artiglieria Occupava una superficie di 180 m2, pesava 30 tonnellate e consumava fino a 150 kw di potenza Dagli anni 50' la 3º rivoluzione industriale ha incrementato la tendenza all'automazione dei processi produttivi ricorrendo all'elettronica e alle tecnologie informatiche. A partire dagli anni '70 inizia lo sviluppo dei moderni computer

- utilizzo dell'informatica e dell'elettronica nel processo industriale

- utilizzo dell'automazione e della robotica

- introduzione dell'informatica in tutte le attività industriali

OGGI l'informatica copre vari temi come programmazione, basi di dati, sicurezza, intelligenza artificiale ... Informatica -> scienza che studia l'elaborazione di dati e il loro trattamento automatico mediante elaboratori elettronici. Nasce come branca della matematica e della logica; studia come trasformare procedure complesse in calcoli elementari da poter essere eseguiti da un sistema automatico 1Le tecnologie informatiche hanno tre funzioni principali:

- elaborare dati per ottenere informazioni significative

- mantenere le informazioni elaborate per utilizzarle in combinazione con altre come dati di un nuovo processo di elaborazione

- organizzare le informazioni in una nuova forma per renderle più comprensibili o più utili

Terminologia Informatica

ALGORITMO: insieme delle operazioni necessarie per risolvere un problema (es. istruzioni lego) Dato un problema possono esistere più algoritmi che lo risolvono PROGRAMMA: implementazione di un algoritmo in un linguaggio formale *. Un algoritmo ha infinite implementazioni in diversi programmi, nello stesso linguaggio e anche in linguaggi diversi * diverso dal linguaggio naturale usato dagli uomini che è equivoco. Il linguaggio formale ha una sola interpretazione HARDWARE: componente fisica del sistema informatico SOFTWARE: insieme dei programmi che fanno funzionare l'hardware. Distinguiamo due categorie:

- sistemi operativi -> permettono all'elaboratore di svolgere le proprie funzioni (software di base)

- programmi applicativi -> svolgono i compiti più vari, in funzione delle esigenze dell'utente (es. Chrome)

Dati e Informazioni

Dati: elementi di Elaborazione di dare forma cioè a qualche cosa; dato o elemento che consente Alcune delle informazioni elaborate diventano nuovi dati da elaborare nella fase successiva di avere conoscenza più o meno esatta di fatti, situazioni, modi di essere, ecc Computer -> elaboratore elettronico digitale elaboratore: esegue automaticamente delle istruzioni elettronico: usa componenti elettronici digitale: elabora informazioni binarie (0 e 1) Esso è costituito da componenti hardware e software che ne definiscono le sue capacità E' una macchina programmabile multiuso in grado di elaborare dati a partire da programmi che descrivono l'elaborazione e i calcoli da compiere. -> esegue programmi (che implementano algoritmi) 2 un'informazione costituiti da simboli (numeri, lettere ... ) che devono essere elaborati, per lo più elettronicamente, secondo un determinato programma Informazioni: l'azione dell'informare,- Programma Programma: serie di istruzioni che, a partire da dei dati di INPUT produce, mediante elaborazione de dati stessi, dati di OUTPUT. Dati (cifre, testi. immagini, suoni, ecc.) Dati in ingresso (INPUT) Dati elaborati in uscita (OUTPUT) Informazioni (per esempio riepiloghi, totali, ecc.) E' in grado di elaborare dati esclusivamente rappresentati con alcuni numeri interi (0 e 1) E' una limitazione dall'hardware

Rappresentazione delle Informazioni

Esistono vari tipi di informazione, così come rappresentazioni diverse della stessa informazione. Il computer memorizza ed elabora informazioni che devono essere rappresentate in una forma gestibile -> rappresentazione digitale Riferendosi a rappresentazione di informazioni/dati si deve distinguere tra:

- Rappresentazione analogica: l'informazione varia in analogia con la realtà, il segnale analogico varia con continuità è misurabile su una scala continua, ossia vi sono infiniti valori fra qualunque coppia di punti sulla scala

- Rappresentazione discreta: l'informazione viene rappresentata con un numero finito di valori significativi diversi. Questo tipo di tecnica fa sempre uso di un codice è misurabile su scala discreta, ossia non esistono valori legali tra due punti vicini della scala

Rappresentazione Digitale

Il "digitale" implica una discretizzazione di elementi continui (analogici). -> trasformazione analogico/digitale Una rappresentazione discreta fa sempre uso di un codice, costituito da:

- simboli: unità fondamentali della rappresentazione

- alfabeto: insieme di tutti i simboli

- parole codice: sequenze di simboli presi dall'alfabeto

- linguaggio: definisce le regole per costruire la parola codice

Codifica Informazione Rappresentazione digitale Decodifica 3

Rappresentazione Binaria

si presta alla tecnologia utilizzata nei computer il transistor collettore base emettitore Se la base riceve una tensione in ingresso superiore a una tensione di soglia, il transistor lascia passare la corrente tra collettore ed emettitore, viceversa la blocca. Si comporta come un interruttore pilotato dalla tensione. Il sistema può assumere valore di 0 o 1 permettendo di realizzare i circuiti elettronici digitali es. funzione sigmoidea 1 y y = 1+e-(w1 2+b) b Il suo input è l'insieme infinito di numeri reali (un insieme continuo) ma il suo output è l'insieme discreto costituito dai valori 0 e 1. Viene utilizzata come funzione di attivazione in molti campi, anche per l'attivazione dei neuroni artificiali nelle reti neurali I primi transistor erano grandi quando una lampadina e per questo motivo i computer erano enormi, pesanti e consumavano moltissima energia elettrica. I transistor attuali sono piccoli pochi nanometri. Ciò ha consentito l'enorme aumento di prestazione degli elaboratori e la riduzione di dimensione e consumo. I processori odierni contengono miliardi di transistor. ! Nella rappresentazione digitale le informazioni sono rappresentate per mezzo di bit. BIT -> entità minima di informazione che possiamo trovare all'interno di un elaboratore. Può assumere due valori, 0 e 1. Rappresentazione binaria -> sequenza finita di 0 e 1 I due simboli possono inoltre essere rappresentati da:

- due stati di polarizzazione di una sostanza magnetizzabile (es. hard disk)

- due stati di carica elettrica di una sostanza (condensatori dei dischi a stato solido)

- al passaggio/non passaggio di corrente attraverso un cavo conduttore (adsl)

- al passaggio/non passaggio di luce attraverso un cavo ottico (fibra ottica)

In generale la rappresentazione binaria è basata sulla presenza (1) e assenza (0) di un fenomeno fisico in un certo luogo, a un certo punto di tempo. N.B. Con un bit rappresento solo due informazioni. Per poter rappresentare più informazioni si usano sequenze di bit. Il processo secondo cui si fa corrispondere ad un'informazione una sequenza di bit prende il nome di codifica dell'informazione. Con N bit si possono codificare 2" informazioni differenti. Se il problema è quello di rappresentare M informazioni differenti si deve selezionare il numero di N bit in modo che 2ª ≥ M 4

Aggregazione di Bit: Byte e Prefissi

Esiste una particolare aggregazione di bit che è costituita da 8 bit (28 = 256 informazioni) = byte byte -> unità di misura per indicare le dimensioni della memoria, del disco, la velocità di download dalla rete internet Prefissi Binari Kilo KB 210 (~ un migliaio, 1024 byte) Mega MB 2 20 (- un milione, 1KB x 1024) Giga GB 2 30 (~ un miliardo, 1MB x 1024) Tera TB 2 40 (~ mille miliardi, 1GB x 1024)

Esercizi sui Bit e Byte

- Quanti bit sono 1 KB? Sappiamo che 1 Kb = 1024 byte e che 1 byte = 8 bit 1024 x 8 bit = 8192 bit

- Quanti byte sono 2 Mb? Sappiamo che 1 Mb = 220 byte. Quindi 2 mb sono il doppio 2 x 220 = 221 byte = 2097152 byte 2097152 byte x 8 = 16777216 bit

- Quanti byte sono 5 Gb? 5 x 230

- Quanti Gb sono 700 Mb? 700 x 220 (converto in byte) : 230

- Quanti Mb sono 1048576 byte? 1048576 : 220 = 1

Codifica dei Caratteri

Nel 1963 nasce l'ASCII (American Standard Code for Information Interchange) Questo include lettere maiuscole e minuscole, cifre numeriche, simboli di punteggiatura e segni matematici. Parliamo di circa 128 simboli M= 128 -> 20 ≥ 128 = 7 -> servono 7 bit per codificare queste informazioni Nel 1981 nasce l' ASCII EXTENDED: aggiunge un bit (8 bit totali) per poter rappresentare più simboli, ad esempio lettere accentate. Si passa a 256 simboli N.B. la codifica ascii consiste nel dividere i bit in byte e cercare nella tabella i simboli corrispondenti. Nel 1992 nasce UTF-8 e nel 1996 UTF-16. Sono codifiche per il character set UNICODE, creato dall'unicode consortium. Vengono rappresentati tutti i simboli usati in tutte le lingue del mondo anche morte, incluse le emoji N.B. Unicode è l'insieme di tutti i caratteri mentre UTF-8 e UTF-16 sono encodings ossia definiscono un algoritmo di mappatura fra i caratteri unicode e le sequenze di bit UTF-8 è lo standard per il web data la sua efficienza nel rappresentare i caratteri più comuni. un carattere può essere lungo da 1 a 4 byte. E' retrocompatibile con ASCII. 5