Modulo I Introduzione al calcolo automatico e all'informatica

Documento sul Modulo I Introduzione al calcolo automatico e all'informatica. Il Pdf esplora i concetti fondamentali del calcolo automatico, l'architettura di von Neumann, la rappresentazione binaria delle informazioni e gli ingranaggi di Internet, utile per studenti universitari di Informatica.

Mostra di più40 pagine

Visualizza gratis il Pdf completo

Registrati per accedere all’intero documento e trasformarlo con l’AI.

Anteprima

Modulo I Introduzione

Il calcolo automatico

Per secoli l'uomo ha cercato di automatizzare il processo di calcolo. L'abaco I primi abachi risalgono al V millennio a.C. È la prima macchina di calcolo nota. L'abaco non è molto diverso da un foglio di carta: la logica e la correttezza dell'operazione dipendono unicamente dall'utente La pascalina Solo dopo il XVII secolo d.C. si ha la prima vera innovazione rispetto all'abaco. la logica dell'operazione è controllata dalla macchina la pascalina permetteva di effettuare "solo" addizioni e sottrazioni. Moltiplicazioni e divisioni potevano essere calcolate mediante ripetizioni di addizioni e sottrazioni, ma era di nuovo l'utente a dover controllare il processo

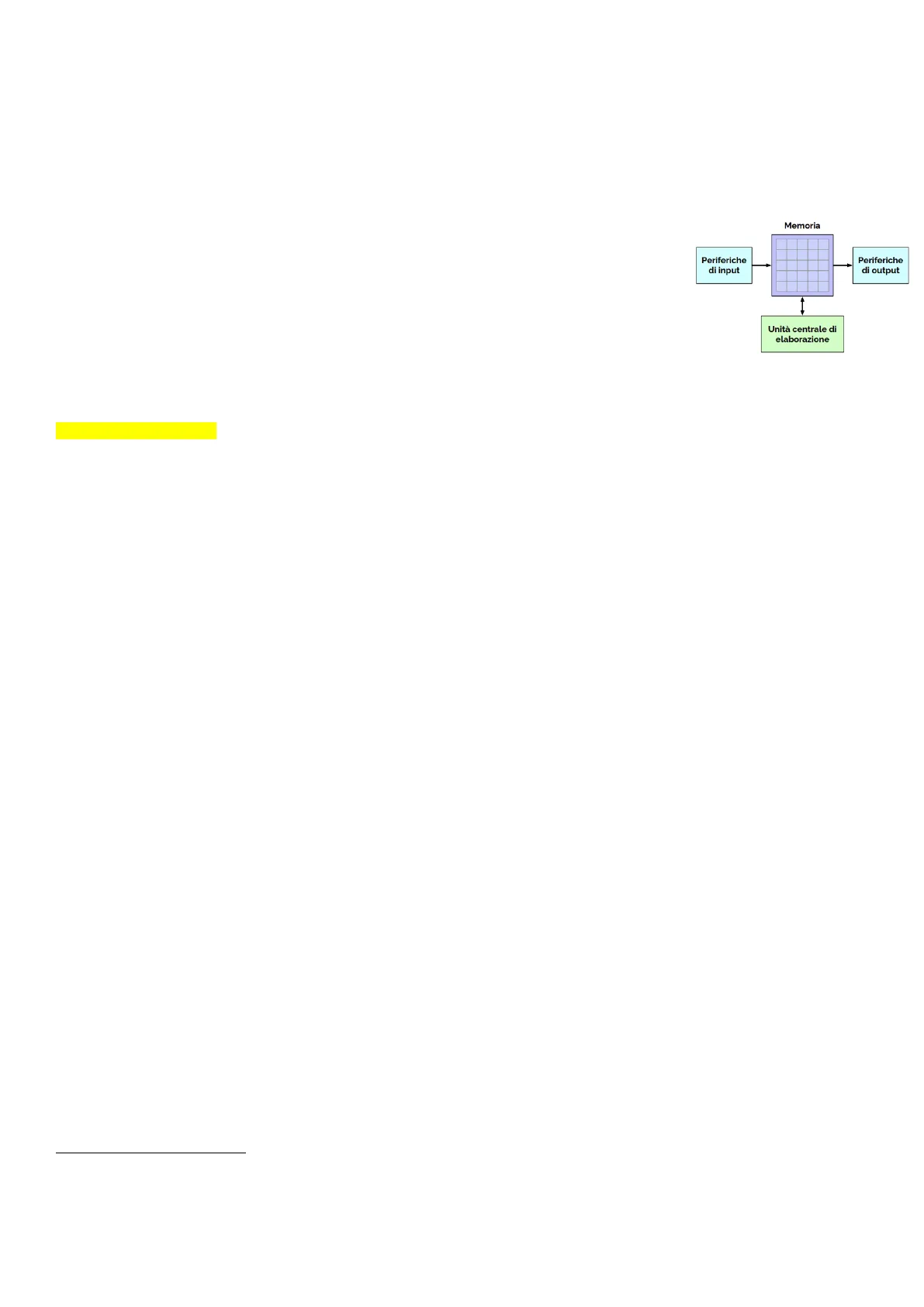

Memoria e Periferiche

Si può pensare di affrontare il problema modificando la macchina pascalina in modo da introdurre la divisione e la moltiplicazione. Ma come calcolare la radice quadrata? Il logaritmo? Non si sta risolvendo il problema, lo si Periferiche di input "rimandando". Il problema vero è che la logica che governa le operazioni è "cablata" nella macchina calcolatrice ... La soluzione è di trattare tale logica come parte dell'input della macchina. In tal modo la logica 1 non dipenderà dalla macchina stessa.

Periferiche di output Unità centrale di elaborazione

La Macchina Analitica e John von Neumann

La Macchina Analitica-> Introdotta da Charles Babbage intorno al 1840, è il primo esempio di macchina di calcolo "programmabile". La tecnologia non era ancora sviluppata a sufficienza (la macchina analitica avrebbe dovuto funzionare a vapore!) John von Neumann-> Nella memoria risiedono i programmi (le istruzioni) e i dati che devono essere elaborati. La caratteristica più importante della macchina di von Neumann è costituita dal fatto che sia dati che programmi vengono trattati in modo sostanzialmente omogeneo, ed immagazzinati nella stessa unità di memoria.

Architettura di von Neumann

Una periferica di input è un qualsiasi dispositivo che permette l'inserimento di dati nel calcolatore. Sono un esempio il mouse, la tastiera, il microfono, la fotocamera, lo scanner etc. Una periferica di output è un qualsiasi dispositivo che permette al calcolatore di mostrare il risultato delle sue elaborazioni all'utente. Il classico esempio è il monitor, ma possiamo menzionare anche le casse audio e la stampante. Le informazioni contenute in memoria vengono elaborate da una singola unità centrale di elaborazione.

Eniac e Informatica oggi

Eniac > Eniac è considerato il primo computer elettronico general purpose della storia (1943) e rispecchia l'architettura di Von Neumann. Costruito durante la Seconda Guerra Mondiale, doveva essere in grado di risolvere principalmente i problemi di calcolo balistico per il lancio dei proiettili d'artiglieria. Occupava una superficie di 180 metri quadrati, pesava 30 tonnellate e consumava fino a 150 kilowatt di potenza Informatica oggi-> Al, chat gpt ... , social, macchine ....

Terminologia e definizioni

L'informatica: Etimologia e Definizione

L'informatica-> Dal Dizionario Garzanti: Informatica Etimologia: Dal fr. informatique, tratto da information) (autom)atique 'informazione automatica' Definizione: scienza che studia l'informazione e, più specificamente, l'elaborazione dei dati e il loro trattamento automatico mediante elaboratori elettronici È anche una branca della matematica e della logica, quella che studia come si possono trasformare procedure complesse in una serie di calcoli elementari, tali da poter essere eseguiti da un sistema automatico, che si tratti di un telaio meccanico o di un computer Informatica: infor(mazione) (auto)matica È l'insieme dei processi e delle tecnologie che consentono la creazione, la raccolta, l'elaborazione, l'immagazzinamento, la diffusione dell'informazione.

Funzioni principali delle tecnologie informatiche

- elaborare dati per ottenere informazioni significative.

- mantenere le informazioni elaborate per utilizzarle in combinazione con altre come dati di un nuovo processo di elaborazione.

- organizzare le informazioni in una nuova forma per renderle più comprensibili, più interessanti o più utili.

Temi dell'Informatica

- Calcolabilità

- Complessità

- Teoria dei linguaggi formali

- Algoritmi e strutture dati

- Linguaggi di programmazione

- Compilatori e interpreti

- Architettura dei calcolatori

- Sistemi operativi

- Ingegneria del software

- Reti di calcolatori

- Interazione uomo-macchina

- Sicurezza

- Intelligenza artificiale

- Basi di dati

Sotto tematiche dell'Intelligenza artificiale

Ciascuno di questi temi contiene tante sotto tematiche più o meno complesse; ad es. L'intelligenza artificiale deve occuparsi di:

- Rappresentazione della conoscenza

- Meccanismi di ragionamento

- Apprendimento automatico

- Pianificazione, scheduling, diagnosi, configurazione, soddisfacimento di vincoli, ecc.

Problemi, algoritmi e programmi

Algoritmo->Insieme delle operazioni necessarie per risolvere un problema (es. istruzioni di un LEGO). Dato un problema, possono esistere più algoritmi che lo risolvono. Programma-> Implementazione di un algoritmo in un linguaggio formale. Un algoritmo ha infinite implementazioni in diversi programmi (nello stesso linguaggio e anche in linguaggi diversi) Problema: è il compleanno del mio amico. Silvio e voglio mandargli una cartolina.Algoritmo:

- Andare in un negozio che vende cartoline.

- Comprare la cartolina.

- Compilare la cartolina con i dati di Silvio ed una frase tipo "auguri".

- Spedire la cartolina.

Problema: effettuare l'addizione di due numeri forniti dall'utente. Algoritmo:

- Chiedere il primo addendo all'utente e memorizzarlo.

- Chiedere il secondo addendo all'utente e memorizzarlo.

- Effettuare l'addizione. - Stampare il risultato

Hardware e Software

Hardware: componente fisica del sistema informatico. Software: insieme dei programmi che fanno funzionare l'hardware. Due categorie principali di software:

- sistemi operativi: permettono all'elaboratore di svolgere le proprie funzioni (software di base come MacOS, microsoft, windows)

- programmi applicativi: svolgono i compiti più vari, in funzione delle esigenze dell'utenza (Google, WhatsApp, word)

Dati e informazioni

DATI-> ELABORAZIONE-> INFORMAZIONI

Computer: definizione e capacità

Computer > Il computer è un elaboratore elettronico digitale elaboratore: dispositivo in grado di eseguire automaticamente una serie di istruzioni. elettronico: usa componenti elettronici. digitale: elabora informazioni binarie (0 e 1) Esso è costituito da componenti hardware e software, che ne definiscono le sue capacità (cosa è in grado di fare). -macchina programmabile, multiuso. - macchina in grado di elaborare dei dati sfruttando i programmi che ne descrivono l'elaborazione e i calcoli da compiere. Esegue programmi (che implementano algoritmi

Modulo II - Rappresentazione delle Informazioni

Tipi di informazione e rappresentazione

Esistono vari tipi di informazione, di natura e forma diversa, così come rappresentazioni diverse della stessa informazione. Ad esempio, lo stesso soggetto catturando la radiazione visibile o la radiazione infrarossa. La scelta della rappresentazione è in genere vincolata al tipo di utilizzo ed al tipo di operazioni che devono essere fatte sulle informazioni stesse. Il computer memorizza ed elabora informazioni che devono essere rappresentate in una forma gestibile. Questa forma gestibile viene chiamata rappresentazione digitale. Tipi di rappresentazione. Riferendosi a rappresentazione di informazioni/dati è si deve distinguere:

Rappresentazione analogica

Rappresentazione analogica > l'informazione varia in analogia con la realtà, il segnale analogico varia con continuità. - Misurabile su una scala continua, ossia, vi sono infiniti valori fra qualunque coppia di punti sulla scala. - Esempi: lunghezza, dimensione, larghezza, circonferenza del cranio, ecc. Date due persone di altezza N e M posso sempre trovare una persona di altezza N< K < M che si piazza nel mezzo.

Rappresentazione discreta

Rappresentazione discreta-> l'informazione viene rappresentata con un numero finito di valori significativi diversi. Questo tipo di tecnica fa sempre uso di un codice. -Misurabile su scala discreta, ossia, non esistono valori legali fra due punti vicini della scala. - Esempi: numero di vendite in una settimana, numero di pazienti ammessi in ospedale. Il numero di pazienti ammessi in ospedale passa da 1, 2, ... , K, K+1, ... e non esiste valore sensato fra K e K+1.

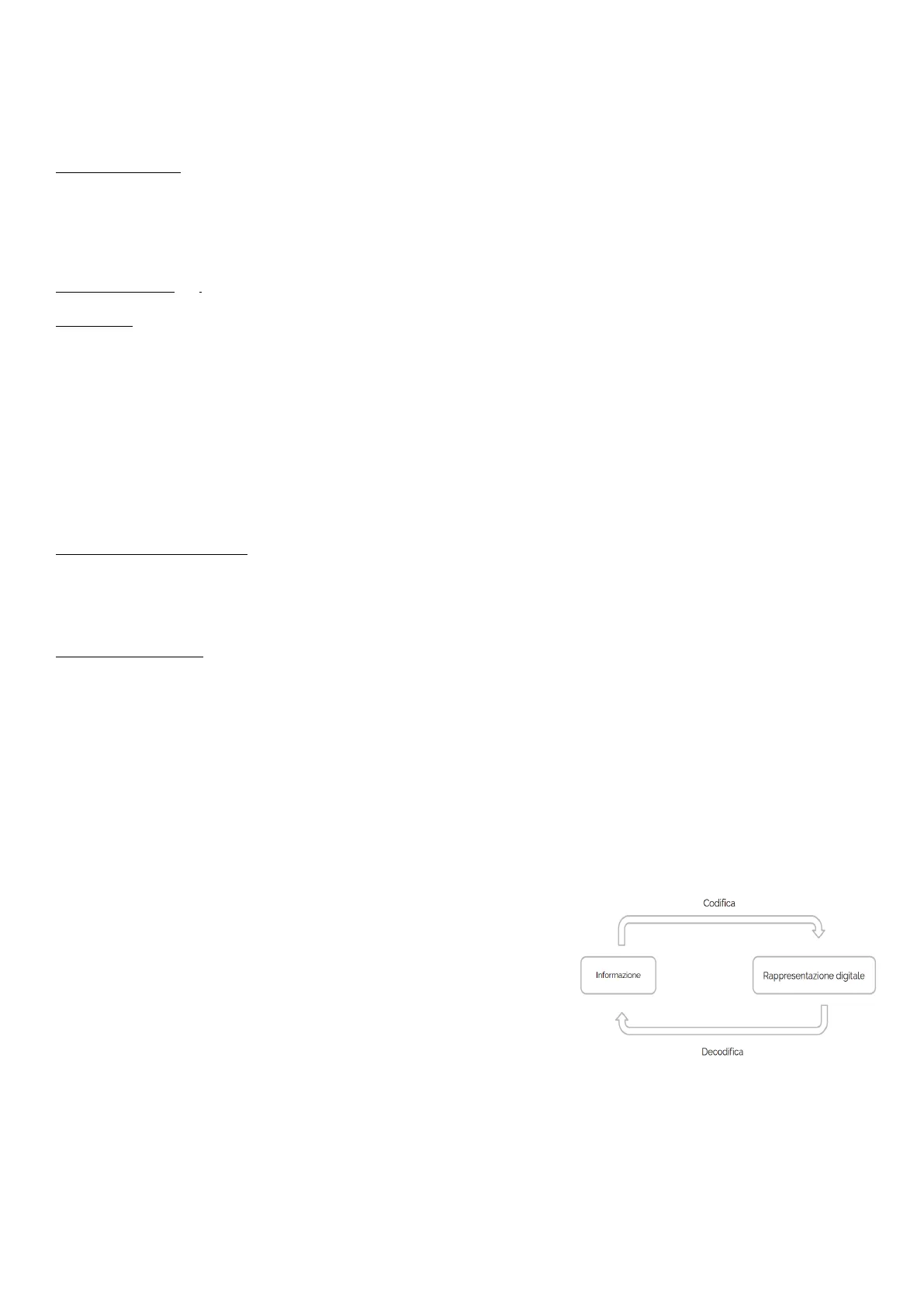

Rappresentazione digitale: Etimologia e Codice

Rappresentazione digitale > Etimologia: dall'ingl. digital, Deriva da digit (cifra, unità numerica). Il "Digitale" implica una discretizzazione di elementi continui (analogici). Questa trasformazione è chiamata trasformazione analogico/digitale Come detto una rappresentazione discreta (come è quella digitale) fa sempre uso di un codice, ossia un insieme di simboli che permette di rappresentare l'informazione. È costituito dai seguenti elementi:

- Simboli: ovvero le unità fondamentali della rappresentazione.

- Alfabeto: l'insieme di tutti i simboli.

- Parole codice: sequenze di simboli presi dall'alfabeto, la cui lunghezza consiste nel numero di simboli di cui ciascuna stringa è composta.

- Linguaggio: definisce l'insieme delle regole per costruire le parole codice, ossia quali sequenze di simboli sono ammissibili e quali no.

Codifica Informazione Rappresentazione digitale Decodifica

Rappresentazione binaria e Transistor

Rappresentazione binaria Perché le informazioni rappresentate nel sistema binario possono essere elaborate secondo vari criteri e con vari strumenti che sono appropriati per essere implementati da un computer. La rappresentazione binaria si presta infatti alla tecnologia utilizzata nei computer: il transistor Se la base riceve una tensione in ingresso superiore a una tensione di soglia, il transistor lascia passare la corrente tra collettore ed emettitore. Viceversa, la blocca. Un transistor si comporta come un interruttore pilotato dalla tensione. Il sistema può dunque assumere il valore binario di "0" o "1", permettendo di realizzare i circuiti elettronici digitali.Prendiamo d'esempio una funzione continua: la funzione sigmoidea Il suo input è l'insieme infinito di numeri reali (un insieme continuo), ma il suo output è l'insieme discreto costituito da i valori 0 e 1. Viene utilizzata come funzione di attivazione in molti campi (molto utilizzata anche per l'attivazione dei neuroni artificiali nelle reti neurali) I primi transistor erano grandi quanto una lampadina, per questo motivo i computer erano enormi, pesanti e consumavano moltissima energia elettrica I transistor attuali sono piccoli pochi nanometri. Ciò ha consentito l'enorme aumento di prestazione degli elaboratori negli ultimi decenni e la riduzione delle loro dimensioni e consumi elettrici. I processori odierni contengono miliardi di transistor

Rappresentazione digitale tramite Bit

Il computer memorizza ed elabora informazioni che devono essere rappresentate tramite la rappresentazione digitale. - Rappresentazione digitale: rappresentare l'informazione per mezzo di Bit. - Bit: L'entità minima di informazione che possiamo trovare all'interno di un elaboratore. Binary digit - cifra binaria. Un bit può assumere due valori. Rappresentazione binaria: sequenza finita di 0 e 1. I due simboli (0 e 1) possono inoltre essere rappresentati da:

- Due stati di polarizzazione di una sostanza magnetizzabile (tecnologia utilizzata ad esempio negli hard disk)

- Due stati di carica elettrica di una sostanza (ad esempio nei i condensatori dei dischi a stato solido)

- Al passaggio/non passaggio di corrente attraverso un cavo conduttore (come avviene nel doppino telefonico per l'ADSL)

- Al passaggio/non passaggio di luce attraverso un cavo ottico (tecnologia utilizzata ad esempio nella fibra ottica)

In generale: la rappresentazione binaria è basata sulla presenza (1) o assenza (0) di un fenomeno fisico (in un certo luogo, a un certo punto di tempo). Con 1 bit rappresentano solo due diverse informazioni:

- 1 è Vero 0 è Falso

- 1 è On 0 è Off

Per poter rappresentare un numero maggiore di informazione si usano sequenze di bit. Per esempio, per rappresentare quattro informazioni diverse possiamo utilizzare due bit che ci permettono di ottenere quattro configurazioni distinte "Il processo secondo cui si fa corrispondere ad un'informazione una sequenza di bit prende il nome codifica dell'informazione" Es. 2 bit=4 informazioni, 3 bit= 8 informazioni Ottimo ->00 Discreto ->01 Con N bit si codificano 2n informazioni. Se dobbiamo rappresentare un numero M di informazioni, si deve selezionare il numero di bit N in modo tale che 2n> = M. 21 = 2 25 = 32 22 = 4 26 = 64 23 = 8 27 = 128 24 = 16 28 = 256 2 alla sesta = 64 >= 40 Quindi la risposta corretta è N=6 Esiste una particolare aggregazione di bit che è costituita da 8 bit (2 8 = 256 informazioni) e prende il nome di byte. Il byte è usato come unità di misura per indicare le dimensioni della memoria, le dimensioni del disco, la velocità di download dalla rete Internet. Di solito si usano i multipli del byte: Usando sequenze di byte (e quindi aggregati di 8 bit) si possono rappresentare caratteri, numeri, immagini, suoni ...

Prefissi del SI e Binari

Prefissi del SI Kilo K 10 3 (un migliaio, 1000) Mega M 10 6 (un milione, 1K) Giga G 10 9 (un miliardo, 1M) Tera T 10 12 (mille miliardi, 1G) Prefissi Binari Kilo KB 210 (~ un migliaio, 1024 byte) Mega MB 2 20 (~ un milione, 1KB x 1024) Giga GB 2 30 (~ un miliardo, 1MB x 1024) Tera TB 2 40 (~ mille miliardi, 1GB x 1024)

Conversione di unità di misura

Simbolo in Bit in Byte in potenze di 2 1 b (bit) 1 1/8 21 = 2 stati (acceso - spento) 1 B (byte) B 1 25 = 256 caratteri 1 KB ( kilobyte) 8.192 1.024 210 byte 1 MB (megabyte) 8.388.608 1.048.576 220 byte 1 GB (gigabyte) 8.589.934.592 1.073.741.824 230 byte 1 TB (terabyte) 8.796.093.302.400 1.099.511.628.000 240 byte

- 1KB =? byte -> 1KB = 1024 byte (Sappiamo che 1KB = 1024 byte)

- 1024 byte =? bit -> 1024 x 8 bit = 8192 bit (Sappiamo inoltre che 1 byte = 8 bit)

Quanti byte sono 2MB? Sappiamo che 1MB = 2 20 byte Quindi, banalmente, 2MB sono il doppio. 2 * 2 20 = 2 21 = 2.097.152 byte. E in bit? un byte equivale a 8 bit, perciò basta moltiplicare per 8. 2.097.152 byte * 8 = 16.777.216 bit. Si può anche calcolare più agevolmente come 2 21 * 2 3 = 2 24 = 16.777.216. fi. 1 y= 1+e-(wTz+b) b Sufficiente-> 10 Insufficente-> 11 Aggiungere un bit raddoppia il numero di informazioni rappresentabili Esempio: per rappresentare 40 informazioni diverse quanti bit bisogna utilizzare? M = 40 2 N >= 40