Introduzione alle serie storiche, modelli ARMA e metodi di previsione

Documento universitario di Matematica sull'introduzione alle serie storiche, ai modelli ARMA e ai metodi di previsione. Il Pdf esplora la rappresentazione grafica e i componenti delle serie storiche, il modello ARMA e i metodi di previsione, con attenzione al criterio dei minimi quadrati e alla regressione lineare.

Mostra di più42 pagine

Visualizza gratis il Pdf completo

Registrati per accedere all’intero documento e trasformarlo con l’AI.

Anteprima

INTRODUZIONE

COS'È UNA SERIE STORICA

L'analisi delle serie storiche si propone di trattare statisticamente dei dati numerici misurati in sequenza temporale; una serie storica, quindi, non è altro che una sequenza di dati temporalmente ordinata e il suo studio permette di analizzarne il trend e prevederne l'andamento futuro.

GRAFICI DI UNA SERIE STORICA

La rappresentazione grafica di una serie storica si basa su un piano cartesiano in cui: · sull'asse X si ha il tempo · sull'asse Y si ha la quantità riferita alla variabile target Si tratta quindi di un caso univariato, in cui l'unica variabile è quella d'interesse.

INTERVALLI DI PREVISIONE

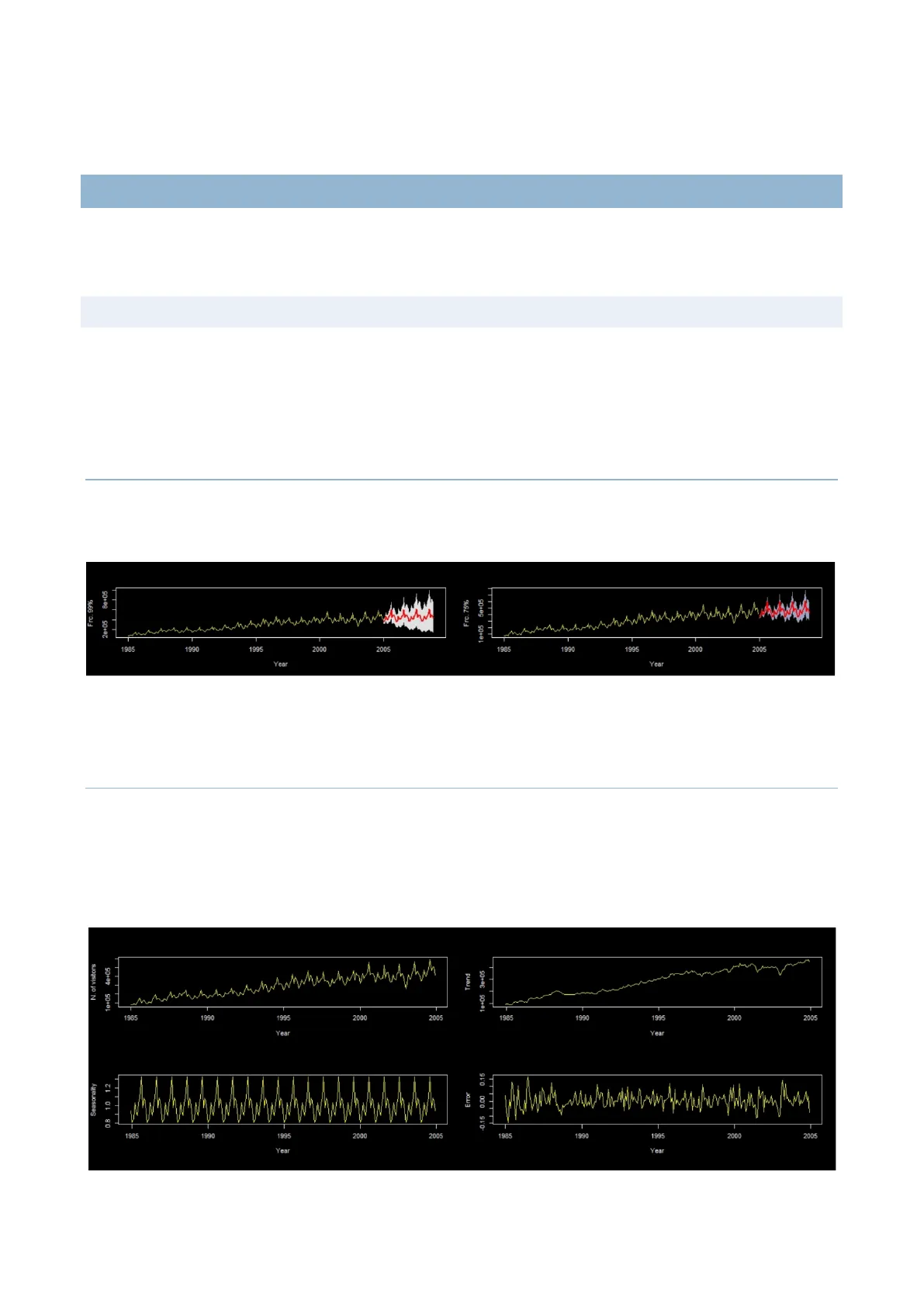

Nei seguenti grafici è rappresentata la medesima serie storica per cui si costruisce una previsione con due intervalli di previsione diversi, uno al 99% e uno al 75%. Frc. 99% 2e+05 8e+05 Frc. 75% 1e+05 5e+05 1985 1990 1995 2000 2005 1985 1990 1995 2000 2005 Year Year In giallo è rappresentata la serie storica, in rosso la previsione e in bianco l'intervallo di previsione, che rappresenta l'incertezza legata alla previsione stessa (più l'intervallo è ampio maggiore sarà la probabilità che la previsione sia corretta).

TREND E COMPONENTI DELLA SERIE STORICA

Una serie storica può essere vista come somma di 3 oggetti diversi:

- trend: andamento della serie storica depurato dalle altre 2 componenti

- componente stagionale: parte del fenomeno legata alla stagionalità

- componente stocastica: parte del fenomeno dovuto al caso

N. of visitors 1e+05 4e+05 Trend 1e+05 3e+05 1985 1990 1995 2000 2005 1985 1990 1995 2000 2005 Year Year Seasonality 0.8 1.0 1.2 Error -0.15 0.00 0.15 1985 1990 1995 2000 2005 1985 1990 1995 2000 2005 Year Year Un evento non è altro che un insieme di dinamiche da leggere; quindi, interpretare il significato della dinamica della serie storica permette di capire cosa succede nel campo di interesse.

APPROCCI ALL'ANALISI DELLE SERIE STORICHE

L'analisi delle serie storiche si basa sulla decomposizione, ovvero l'idea che una serie storica sia data dalla somma di n "sotto-serie"; oltre alla decomposizione, è possibile anche analizzare l'impatto di regressori esterni sulla serie storica, come per esempio l'influenza dei saldi sulle rendite nel tempo. Gli obiettivi dell'analisi delle serie storiche (studio di trend e previsioni future) si intersecano con gli approcci utilizzati:

- modello ARMA: approccio orientato direttamente alla previsione punto

- approccio orientato alla decomposizione e previsione (previsione = somma previsioni componenti)

- deep learning: approccio algoritmico

In particolare, il modello ARMA è il fondamento logico-matematico di tutte le serie storiche e ha come obiettivo la previsione punto; la serie storica viene vista come un insieme di variabili casuali interdipendenti che si vogliono modellizzare in un modello parametrico universale.

MODELLIZZAZIONE E PREVISIONE DI SERIE STORICHE STAZIONARIE

PROCESSI STOCASTICI DISCRETI

PROCESSI STOCASTICI

Una serie storica consiste in un insieme di osservazioni numeriche considerate dal tempo t = 1 a t = T; si tratta quindi di un vettore di numeri ordinati temporalmente. In corrispondenza di ogni t della serie storica si ha una variabile casuale Y indicizzata dal tempo corrispondente: t -1 +00 Yt-1 t 1 Yt t+ 1 Yt+1 Le osservazioni sono quindi gli outcome delle variabili casuali. La prima assunzione importante che bisogna fare a proposito delle serie storiche è che l'insieme delle variabili casuali esista tra +00: {Yttez con Z = {0, +1, +2, ... + 00} Si tratta quindi di un vettore di variabile con limite infinito, chiamato processo stocastico a tempi discreti; ogni singola variabile casuale del processo è una variabile casuale vettoriale bi-infinita per cui vale: E (x)= E(x1) E (Xn) ... La realizzazione del processo è chiamata traiettoria e consiste in un vettore in cui è presente un solo outcome per ogni variabile che interessa la serie storica; è possibile quindi definire la serie storica come una parte finita di una traiettoria di un processo stocastico, dove la parte finita corrisponde alle osservazioni. La previsione, la cui condizione necessaria è che esistano delle dipendenze tra le variabili casuali, consiste quindi nel capire su quale traiettoria ci si trova. Per concretizzare questo concetto si consideri l'apertura di un nuovo negozio: seguendo l'assunzione appena fatta, bisogna immaginare che questo esista dal tempo -o e che si inizi a studiare il fatturato dal tempo 0.

IPOTESI NECESSARIE PER I PROCESSI STOCASTICI

La prima ipotesi necessaria che riguarda i processi stocastici è che essi abbiano media (e varianza) finita: · E(Yt) < co Vt · E(Y2) < co Vt => < 00 La seconda ipotesi riguarda le previsioni; infatti, per farle è necessario assumere di avere variabili dipendenti e assumere che ci sia regolarità nella struttura del processo stocastico. Oltre a ciò, bisognerà anche essere in grado di modellizzare la dipendenza tra le variabili. La terza ipotesi riguarda invece la regressione; per fare una previsione rispetto ad una variabile casuale in funzione di altre è possibile usare la regressione. In particolare, la regressione multivariata (che consiste in una proiezione ortogonale) è così definita: L=X(XtX)-1XtY quindi per fare una previsione sarà necessario conoscere le covarianze tra le coppie di regressori e le covarianze tra le singole covariate e la variabile target.

IPOTESI 2: CARATTERISTICHE DI REGOLARITÀ

STAZIONARIETÀ IN SENSO FORTE

La prima assunzione possibile riguardo alla regolarità del processo stocastico è la stazionarietà in senso forte, per cui la congiunta è invariante nel tempo: Vk E N, Vt1 ... tk, Vh E Z P(Yt] = y1, ... , Ytk = yk ) = P(Yt1+h = y1, ... , Ytk+h = yk) questo significa che la struttura non cambia in base al tempo e traslando le variabili di h, la loro probabilità di assumere i valori originari sia identica. Per esempio, tra i tempi t = 1, t = 10 e t = 21, t = 30 la probabilità che la medesima variabile assuma lo stesso valore è uguale.

STAZIONARIETÀ IN SENSO DEBOLE/AL SECONDO ORDINE/IN COVARIANZA

La stazionarietà in senso debole è un'assunzione meno forte che riguarda la struttura del processo stocastico e prevede variabili casuali con:

- media uguale -> E (Yt) = u Vt

- covarianza che dipende solo dalla loro distanza temporale -> cov(Yt, Ys) = cov(Yt+h, Ys+h) Vt, s, h

La covarianza non dipende dai singoli tempi assoluti t, s ma solo dalla loro distanza temporale k = |t - s|; la covarianza è quindi una misura unidimensionale e si denota come y (k) O Yk· Per esempio, la covarianza tra le due variabili Y15, Y20 si denota come y(|15 - 20|) = Y5; inoltre, si parla di autocovarianza Yo per indicare la covarianza tra Yt, Yt (uguale alla varianza della variabile): Yo = Y(0) = cov(Yt, Yt) = var(Yt) = of costante Per quanto riguarda la correlazione in funzione di y si ha: p = var (Yt)var (Ys) cov(Yt, YS) Yk VYoYo Yk = ACF Yo dove ACF sta per AutoCorrelation Function. Il processo ha una struttura di covarianze indipendenti dal tempo e quindi una struttura lineare invariante per traslazione temporale. Inoltre, per quanto riguarda la relazione tra Yo e Yk, si ha che Yo è il valore massimo di Yk: Ipkl = * |≤1 => 1kl ≤ Yo Esiste inoltre una terza ipotesi aggiuntiva che riguarda le variabili casuali, ovvero che esse abbiano una distribuzione normale: Vk > 0 EN, Vt1 ... tk, Vh EZ (Yt, ... , Ytk)~N (u, r) dove u è un vettore di k-volte u e l' è la matrice di varianze e covarianze. La congiunta è Gaussiana e I' dipende solo dalle distanze, quindi essa è invariante per traslazione temporale siccome anche media e varianza lo sono. In particolare, la matrice di varianze e covarianze I' è una matrice di Toeplitz in quanto le sue diagonali sono costanti e simmetriche: T = -YT-1 Y1 Yo Y1 Y2 Y : Yo ... Y1 Yo % Y2 Y2 ... Y2 Y1 ... YT-1 Y1 Yo : con lij = cov(Yi, Yj) = Yk = Yli-jl Per riassumere, si ha stazionarietà in senso: · forte, quando l'assunzione è sulla congiunta (e valgono anche le ipotesi "deboli") · debole, quando le assunzioni sono sui momenti

COEFFICIENTE DI CORRELAZIONE PARZIALE, R2 E FUNZIONE DI AUTOCORRELAZIONE PARZIALE

COEFFICIENTE DI CORRELAZIONE PARZIALE

Si considerino 3 variabili X, Y,Z e si immagini di voler calcolare il coefficiente di correlazione parziale tra X, Y al netto di Z si calcola il coefficiente di correlazione tra i residui delle regressioni di X,Y in funzione di Z: (X = BxZ + Ex Y = ByZ + Ey - ΥΧΥΙΖ = ΠΧΥΙΖ = ρ(εχ, Εγ) In generale, la regressione multivariata è data da: Î = X(XtX)-1XtY = PY dove P è un proiettore ortogonale, quindi pt = P2 = P. Nel caso di un sottospazio vettoriale V = V1 + V2 dato dalla somma diretta di V1, V2, gli elementi dei due sottospazi sono ortogonali (x1, X2) = 0 ed esiste un unico elemento x = x1 + X2. In questo esempio, un proiettore ortogonale dello spazio V1 scompone l'elemento x nella sua componente x1: Pvx: X -> X1 = Pv2 = I - Pv1 e Pv, Pv2 = 0

BONTÀ DI ADATTAMENTO R2

La bontà di adattamento R2 corrisponde alla lunghezza del vettore proiettato; rappresentando i vettori in un'altra base è possibile modificare le X lasciando R2 invariato: un generico vettore x rappresenta quindi lo stesso oggetto geometrico ma avrà componenti diverse in base alla base scelta.

FUNZIONE DI AUTOCORRELAZIONE PARZIALE

La funzione di autocorrelazione parziale PAFC Ttk prende in input una serie di variabili Yt ... Yt+k e, attraverso la regressione di Yt, Yt+k rispetto alle variabili che si trovano tra queste, calcolando i residui Et, Et+k, si traduce nella seguente formula: TK = corr (Et, Et+k)

WHITE NOISE

Il processo stocastico White Noise Gaussiano, indicato con {Et}tez, si basa su una successione di variabili indicizzate da t con le seguenti caratteristiche:

- E(Et) = 0 Vt

- var(Et) = og Vt

- cov(ες, Et)=0 Vst

- Et~N(0,02) Vt

Si tratta quindi di variabili con media nulla, varianza costante, incorrelate e, come ipotesi aggiuntiva, distribuite normalmente; l'incorrelazione tra le variabili implica l'assenza di una struttura di covarianza. Il processo stocastico White Noise è basilare ma permette di costruire altri processi stocastici.