Distribuzione cumulativa, Bernoulli e curva normale in Matematica

Documento universitario di Matematica sulla distribuzione cumulativa. Il Pdf esplora le distribuzioni discrete, con un approfondimento sulla distribuzione di Bernoulli e i suoi concetti chiave, e descrive la curva normale, i suoi parametri e la sua applicazione in ambito biomedico, inclusa la standardizzazione.

Mostra di più13 pagine

Visualizza gratis il Pdf completo

Registrati per accedere all’intero documento e trasformarlo con l’AI.

Anteprima

Statistica, Lezione 7, 15/05/2024

Prof. Danila Azzolina

Distribuzione cumulativa

La distribuzione cumulativa è la translazione in termini teorici di quanto che si è visto quando si è parlato di frequenza relativa cumulata. La distribuzione cumulativa si denota con il simbolo +(x) e definisce, per la normale standardizzata, la probabilità che la variabile in esame x assuma valori inferiori uguali a un certo percentile x.

La docente puntualizza l'utilizzo di x e X in statistica. In statistica X (maiuscolo) denota la variabile (in realtà, una qualsiasi altra lettera maiuscola denota una variabile), mentre x (minuscolo) denota la realizzazione, l'osservato, il dato puntuale. (Concetto ripreso dalle sbobine dello scorso anno e qui riportato per una maggiore chiarezza).

La distribuzione cumulata è la funzione che permette di caratterizzare il comportamento della maggior parte delle variabili che riguardano i fenomeni studiati in campo biomedico. Quindi questa distribuzione ha un connotato importante in clinica.

Esempio di distribuzione cumulativa

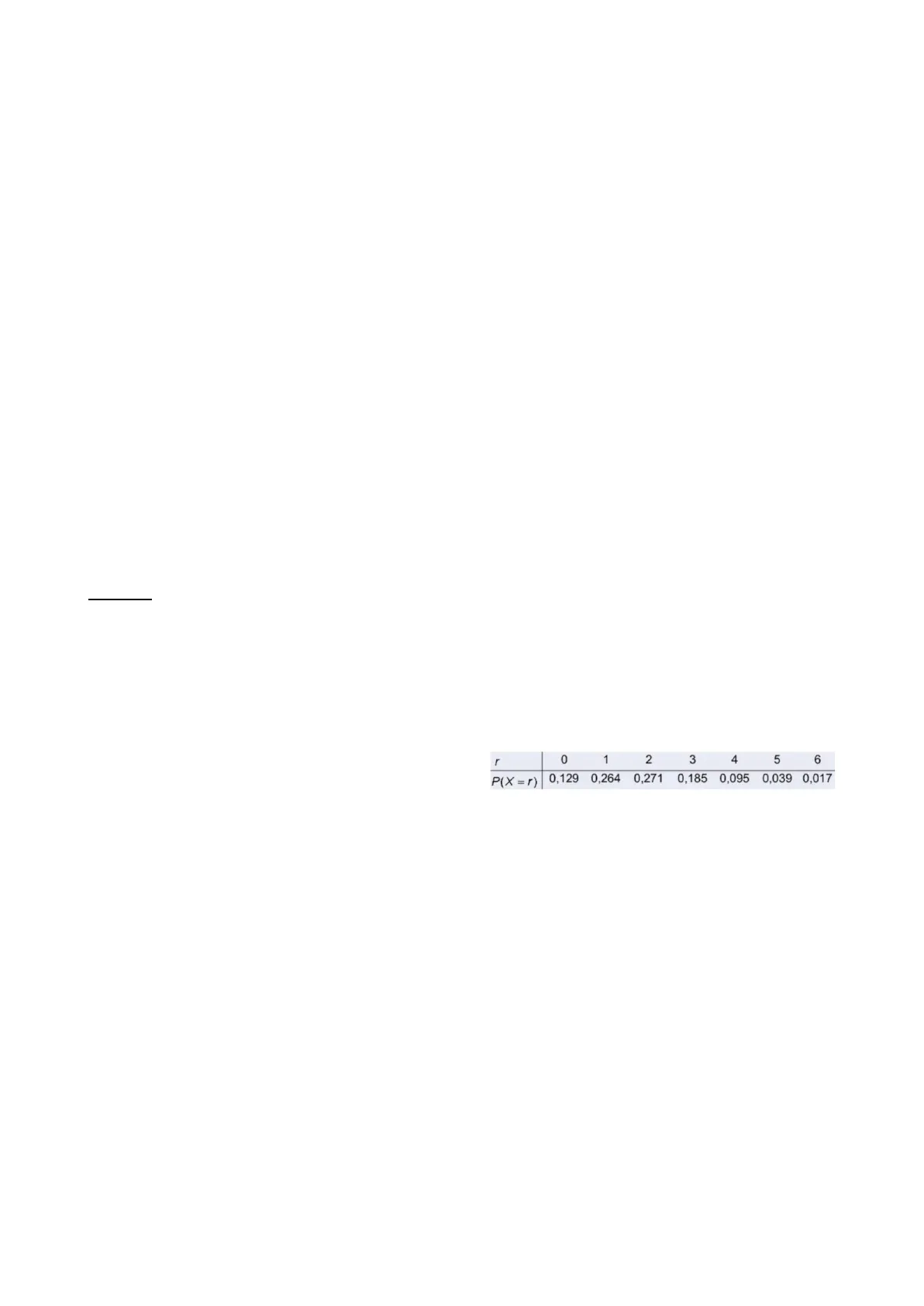

Nell'esempio a fianco vengono mostrati episodi di otite media nei primi due anni di vita di un bambino e indica la probabilità che la variabile in esame X assuma un valore più piccolo di una determinata realizzazione x piccolo. Quindi se il numero di episodi di otite media nei primi due anni di vita è la variabile di interesse, si deve osservare che essa comprende da zero a sei possibili eventi:

- 0 episodi di otite

- 1 episodio di otite

- 2 episodi di otite

- 3 episodi di otite

- 4 episodi di otite

- 5 episodi di otite

- 6 episodi di otite

r

0

1

2

3

4

5

6

P(X =r)

0,129 0,264 0,271 0,185 0,095 0,039 0,017

Essa quindi indica la probabilità che la variabile in esame X assuma valori più piccoli di un determinato percentile x. Sommando in modo cumulativo tutte le modalità della variabili, ottengo il 100% della distribuzione. Esattamente come si è visto quando si è parlato delle frequenze di distribuzione.

Su zero episodi la probabilità di osservarne è 0,129; La probabilità di osservare fino a un episodio si ottiene facendo 0,26+ 0,129= 39,3%; fino a tre episodi di tenere bambini è data dalla 0,129+ 0,264+ 0,271 + 0,185. E così via.

1Posso quindi osservare come questa tipologia di calcolo renda chiaro che è difficile osservare più di quattro casi di otite nei primi due anni di vita.

Dist. cumulativa del numero di episodi di otite

Queste informazioni possono essere riportate anche

10

su un diagramma. Sull'asse delle x si hanno i

numeri di episodi di otite da zero a sei, sull'asse

06

delle y vengono riportati i valori delle proprietà

Probabilità

04

cumulate. Nella curva si avrà un andamento

02

continuo sigmoide che tende a raggiungere il

Numero di episodi

massimo, in corrispondenza del 100% della massa di probabilità.

Distribuzioni discrete

Una variabile discreta presenta un numero definito di probabilità. Sono più comunemente usate per catalogare eventi naturali in campo biomedico.

La più comune è la distribuzione di Bernoulli, che in statistica si chiama evento bernoulliano.

In questi casi l'esito dell'evento è binario e quantificabile semplicemente come successo o insuccesso.

Esempio tipico in statistica: lancio moneta con esito testa o croce

- Testa: successo con probabilità p

- Croce: insuccesso con probabilità q=1-p

Gli esistiti sono complementari: ad esempio se la probabilità di successo di un'operazione è dell'80%, allora la probabilità di insuccesso del 20%.

Il valore atteso di questa variabile è:

E[X]=>x, .P(X = x;) = 0 . (1- p) +1. p = p

i=1

2

...

j=1

La varianza è data da:

Var(X) = >(x, - p)2 · P(X = x,) = p2 . (1-p) +(1- p)2 . p = p.(1-p).

Spesso il fenomeno binario difficilmente singolo, ma ripetuto, è utilizzato in ambito biomedico. La variabilità di questi fenomeni binari dipende sostanzialmente dalla probabilità di successo del singolo esito. Questo si vedrà successivamente quando si parlerà della distribuzione binomiale (che è una derivazione della funzione di Bernoulli, sopracitata).

2La distribuzione Binomiale: è definibile come la legge di probabilità che modella le proporzioni. Quindi la distribuzione binomiale va a modellare il numero di successi, a condizione che valgano delle assunzioni, e i suoi esiti devono obbligatoriamente essere binari.

Devono inoltre valere i concetti di:

- indipendenza: devo assumere che la probabilità di riuscita in un operazione non vada ad inficiare su un'operazione successiva.

- equa distribuzione = il risultato deve essere costante su tutte le operazioni, ossia si deve mantenere più o meno costante la probabilità di successo.

Ovviamente la probabilità di successo potrebbe essere compromessa da altre comorbilità del paziente, motivo per cui generalmente vengono usati pazienti "standard", oppure vengono utilizzate tabelle inclusive delle differenti patologie del soggetto preso in analisi, con specifiche su come esse possano influire sul risultato ottenuto. Ovvero ci si chiede quale sia il numero limite di comorbilità per cui si continuino ad ottenere successi.

Si analizza quindi una funzione che indichi qual'è la probabilità di osservare un numero di successi esattamente pari a K. Vengono quindi definiti numeri di prove, operazioni, analisi, per cui si capisca quale sia da 0 a 10 la probabilità di osservare un successo.

La probabilità che in n prove avvengano k successi e quindi n - k insuccessi è pari a:

p* (1- p)"-k

Tenendo conto che i k successi si posso ottenere in Ck modi diversi, si ha che:

P(X=)=(*)*(1-p)

p*(1- p)"-k k =0,1, ... ,n

che rappresenta la distribuzione di probabilità binomiale.

La variabilità è data da:

var(X)=>(k-np)2

k_0

n

n

K

p"q" -* = npq

q= (1-p) probabilità di insuccesso

n= numero di prove

p= probabilità

Il fenomeno è tanto più variabile quanto più la probabilità di successo è vicina a 0,5.

Nel grafico si osserva come sull'asse delle X ci sia la probabilità, mentre sull'asse delle Y ci sia probabilità per probabilità di insuccesso.

3Questa tipologia di grafico viene utilizzata negli studi per

poter quantificare la probabilità di successo posta una

variabilità massima. Questo permette, nel momento in cui

vengono gettate le basi sperimentali per l'inizio dello

studio, di osservare tanti più soggetti o casi, quanto più la

variabilità risulta essere alta.

La binomiale, che è una distribuzione discreta spesso

tende a somigliare ad una distribuzione continua,

soprattutto se si ha un alto numero di pazienti arruolati

nello studio.

Grafico di pa vs p

0.25

0.20

0.15

b. d

0.10

0.05

0.0

0.0

0.2

0.4

0.6

0.8

1.0

P

Distribuzione di Poisson

La distribuzione di Poisson è una distribuzione casuale discreta di media e varianza identiche che si utilizza per calcolare la probabilità che un certo evento si manifesti esattamente x volte in una certa unità spazio-temporale, gestisce quindi le incidenze.

I casi incidenti indicano il numero di casi di malattia che si possono osservare sulla popolazione in un determinato arco di tempo. I casi prevalenti, ovvero la prevalenza, sono i casi di malattia che possono essere osservati in un preciso istante di tempo.

La distribuzione di Poisson modella il numero di eventi che si possono osservare in un determinato arco di tempo, durante il quale i soggetti sono esposti a un particolare rischio, oppure in un determinato ambito spaziale.

Esempio 1: febbre tifoide

Esempio 1: la distribuzione del numero di morti attribuito alla febbre di tifoide in un anno può essere definita da una legge di Poisson, perché si ha il tempo di esposizione, e quindi possono essere definiti quanti eventi (numero di morti) per unità di tempo.

Esempio 2: colture cellulari

Esempio 2: si supponga di avere una piastra per colture cellulari di 100 cm2 e che la probabilità di trovare una colonia batterica in un intorno piccolo di un determinato punto a sia molto piccola e che il trovare dei batteri in due punti a1 ed a2 siano eventi indipendenti. se valgono queste assunzioni, allora il fenomeno si può modellare come una distribuzione di Poisson.

La legge di Poisson possiede due assunti:

- indipendenza: si assume che la probabilità di una nuova morte sia molto piccola, ovvero i vari casi analizzati, e che il numero di casi in 2 periodi distinti sono indipendenti l'uno rispetto all'altro. Ritornando all'esempio, si può dire che la probabilità di osservare un caso di febbre tifoide nel giorno x, non impatti sulla probabilità di trovare un secondo caso il giorno dopo. La probabilità di osservare l'evento in tutto

4l'arco di tempo considerato è costante, quindi non c'è trend (ripreso dalla sbobina dello scorso anno, e qui riportato per una maggiore chiarezza.)

- stazionarietà: la probabilità di osservare l'evento in tutto l'arco di tempo considerato è costante, quindi non c'è trend. Esempio di questo si ha con il fumo di sigaretta, che ha conseguenze nocive sulla salute, che diventeranno evidenti solo con il tempo.

Esiste una legge che permette di attribuire la probabilità di osservare vari eventi in un arco di tempo, praticamente la probabilità deriva dall'arco di tempo considerato.

La probabilità di osservare k eventi in un periodo t per variabile aleatoria di Poisson di parametro 2>0 (con 2= probabilità della singola morte nello spazio di tempo).

Dato un intervallo di tempo At, si ha che:

- la probabilità di osservare una morte è direttamente proporzionale alla lunghezza dell'intervallo di tempo At, ovvero P(1 morte) ~ 2At (dove 2 è una costante);

- la probabilità di osservare 0 morti nell'intervallo At è approssimativamente 1 - 2 At.

P(x)=" e-

la formula permette di calcolare la

probabilità che si presentino "x" casi

conoscendo il numero medio di casi " 2"

Esercizio: un ascensore si guasta in media 2

volte l'anno, la probabilità che non si guasti

mai è:

P(X=0) =e -2 2

=0,14= 14%

0!

probabilità che si presenti x=0 casi

Esempio: calcolo probabilità

Esempio: Bisogna fare l'esponenziale ponendo che x sia uguale a 0,

esattamente come mostrato nell'immagine a fianco.

Si supponga che il numero di morti attribuite alla febbre tifoide in un

anno siano 5, con 2 = 4,6. Data questa informazione, posto che vale

la legge di Poisson, si può capire quale sia la probabilità di osservare

O eventi, e quale sia la probabilità di osservare più di 6 eventi.

e X26 in un periodo di 6 e 3 mesi.

Considerando 6 mesi, da A = 4,6/anno passiamo a A = 0,5-4,6/anno=2,3/6 mesi e

otteniamo:

P(X =0) = e-2,3 =0,100 P(X≥6)=1-P(X<6)=1-P(0)-P(1) -...- P(5)=0,030.

Considerando 3 mesi, da A = 4,6/anno passiamo a A = 0,25·4,6/anno=1,15/3 mesi e

otteniamo:

Considerando 6 mesi, da 2 = 4,6/anno passiamo a 2 = 0,5-4,6/anno=2,3/6 mesi e otteniamo

(nb. 0,5 per indicare che si sta parlando di 6 mesi, ovvero 1/2 di anno) :

5